بتعلم AI بالتجربة والغلط: رحلتي في 20 شهر من الصفر للـ Agentic Workflows

من محاضرة في الإسكندرية للـ Agentic AI: رحلتي الحقيقية 2024-2026

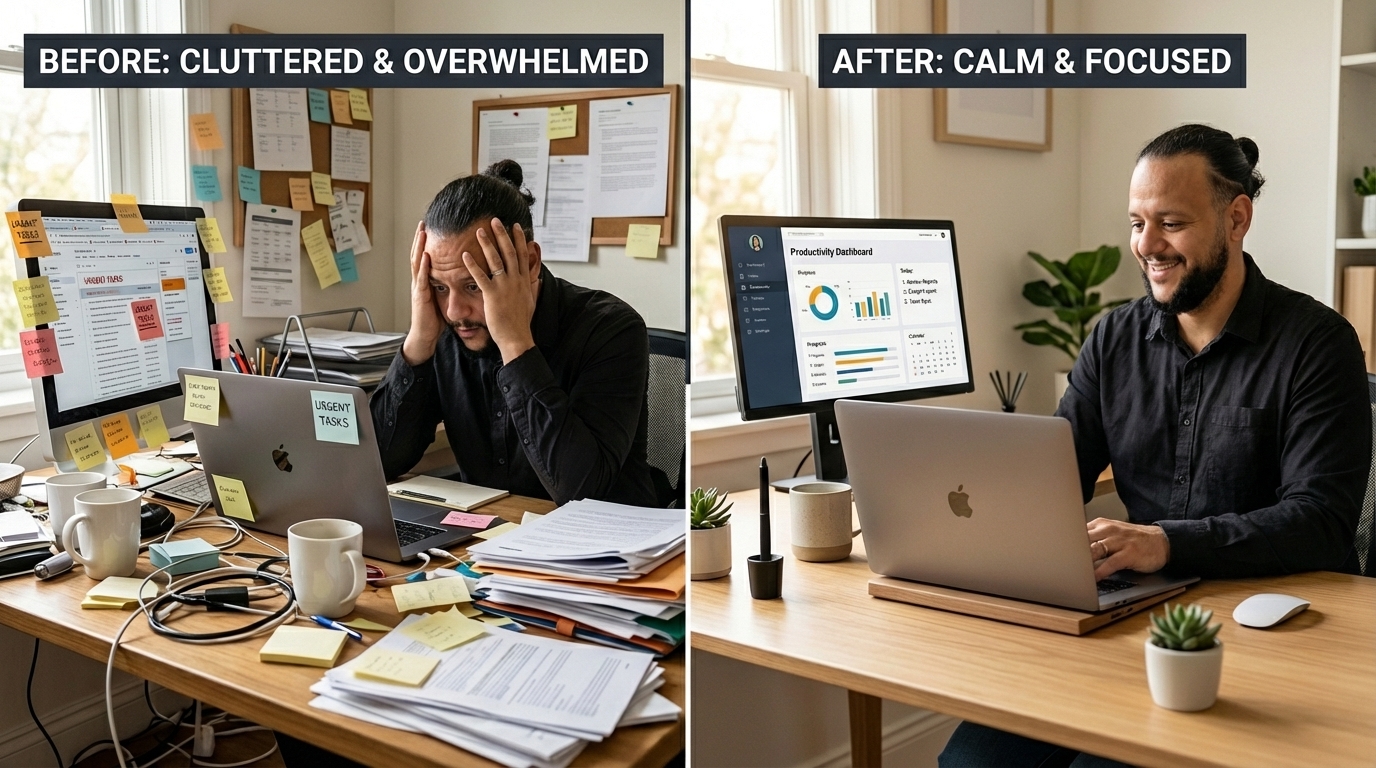

كنت صفر على الشمال في الـ Generative AI. بعد عشرين شهر، بشغّل agentic workflows، وبصوّن موقعي بـ AI-powered IDEs، وإنتاجيتي اترفعت على الأقل 10 مرات في مهام كانت بتاكل ساعات.

البوست ده عن كل حاجة حصلت بين النقطتين دول. التجارب اللي نجحت، والهاردوير اللي خذلني، والفلوس اللي صرفتها، واللحظة اللي اكتشفت فيها إني كنت بتفرج في الاتجاه الغلط خالص.

منتصف 2024: صحوة الإسكندرية

كنت في إجازتي السنوية في الإسكندرية لما صادفت حدث في مكتبة الإسكندرية. اللي نظّمه كان المهندس محمد حنفي، واحد من مدرّسيني في ITI لما اتعلمت تطوير البرمجيات سنة 2010.

اتكلم عن حاجات كتير: إيه هي الـ LLMs، والـ chatbots، والأتمتة، وإنشاء الصور، وتحرير الفيديو، وإزاي تستخدم كل ده في التسويق وإنتاج المحتوى. المحاضرة دي كانت فاتحة عين بجد. اتضح لي إن حاجة ضخمة بتحصل وأنا كنت متجاهلها.

رجعت هولندا وفي دماغي فكرة واحدة بس: لازم ألحق. وبسرعة.

سبتمبر 2024: بقيت فريق محتوى من واحد

كنت محتاج مشروع يخليني أستخدم أدوات الـ AI فعلاً، مش بس أقرا عنها. فعملت صفحة فيسبوك بريلز موجّهة للجالية المصرية في هولندا.

استخدمت LeonardoAI لإنشاء الصور، وChatGPT لكتابة المحتوى، وPhotoroom لعمل الـ thumbnails. أول برومبتات كانت وحشة. بتعرف إيه اللي بيشتغل لما تحتاج حاجة محددة وتلاقي المحاولة التالتة بردها مش جايبة المطلوب. لكن التكرار خلّاني أتحسن بسرعة.

ليه LeonardoAI ومش Midjourney؟ بصراحة: الكريدتس المجانية. بتنقّل بين الاتنين حسب مين لسه عنده رصيد. لما LeonardoAI يخلص، باروح Midjourney. ولما Midjourney يخلص، بارجع. حل رخيص. بيشتغل.

الصفحة أخدت تفاعل حقيقي. فيديو واحد وصل لآلاف المشاهدات. لكن اللي فاجأني مكنش في الأرقام. كان في إني كنت بعمل شغل فريق كامل بنفسي: توليد أفكار، بحث، كتابة سكريبت، تصوير، مونتاج A-roll وB-roll، نشر، وترويج. شخص واحد، والـ AI بيعمل الأجزاء اللي كانت محتاجة مصمم وكاتب ومحرر فيديو. دي كانت أول مرة الـ AI حسّيت فيه إنه مضاعف حقيقي للإنتاجية، مش لعبة.

بس كنت بوصل لسقف. كل حاجة شغّالة على cloud APIs. كنت عايز أشغّل موديلات محلياً، أجرّب حاجات تانية، أغوص أكتر. اللاب توب القديم مش هيكفي.

حان وقت أصرف فلوس.

أواخر 2024: فخ الهاردوير

المحاولة الأولى: Jetson Orin Nano ($249)

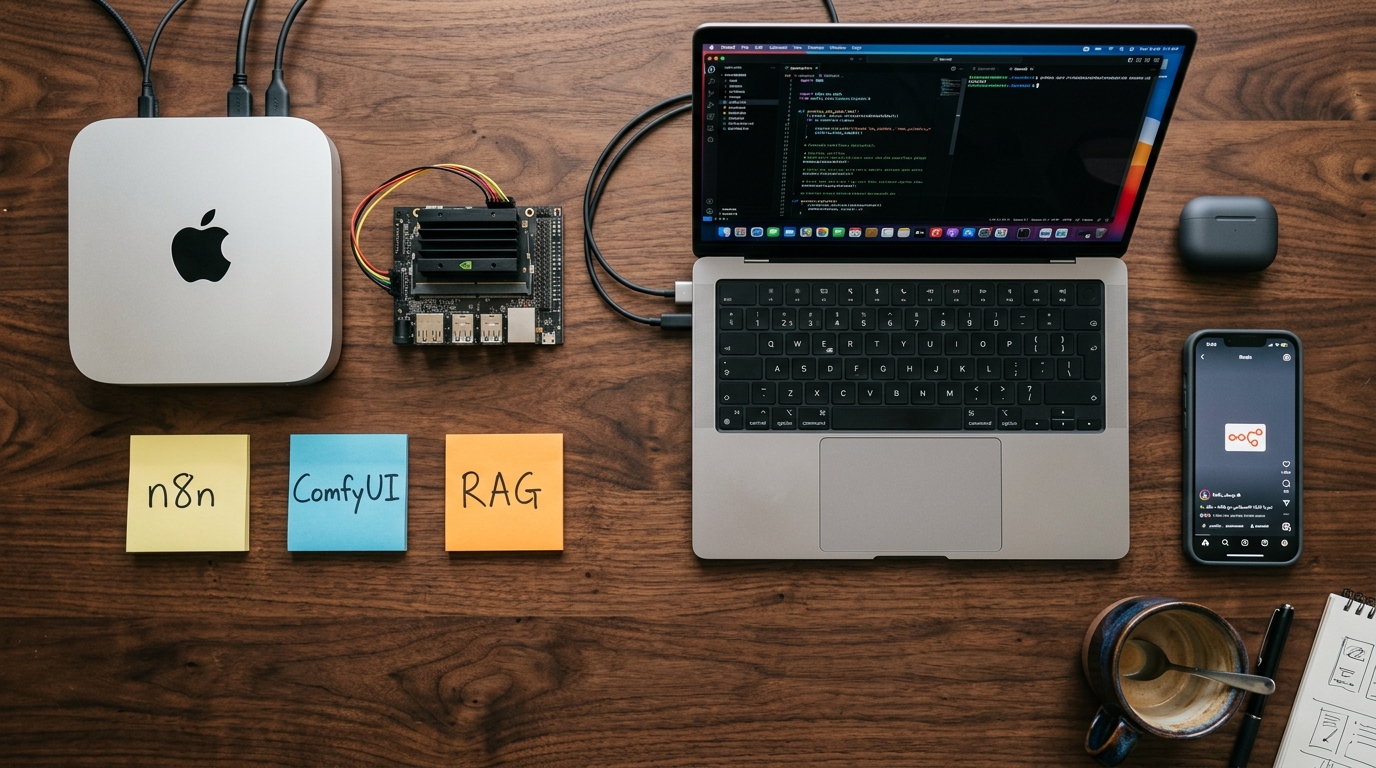

أول استثمار كان Jetson Orin Nano Super Developer Kit. حدّثت الفيرموير، تعرّفت على مواصفات الـ 67 TOPS، وحاولت أفهم منظومة Nvidia حول الـ AI على الـ edge.

ضبطت workflows بـ n8n وComfyUI، اشتغلت على diffusion models وLoRA، جرّبت TTS، ونزّلت موديلات من HuggingFace.

كان ماشي. لكن الحقيقة إن 8GB GPU memory مش كفاية. حتى الموديلات الصغيرة كان فيها مشاكل في الأداء. ده كان مزعج. فقلت: ممكن المشكلة في الجهاز مش في الفكرة.

المحاولة التانية: Mac Mini M4 (€700)

روحت على Mac Mini M4 بـ 16GB shared memory. كانت خطوة للأمام. نصّبت Ollama وComfyUI وn8n، والأمور اشتغلت أحسن من الـ Jetson.

لكن شريحة Mac Silicon جابت مشاكلها الخاصة. Stable Diffusion وFlux مكانوش بيشتغلوا بـ GPU acceleration لأنهم اتبنوا وتحسّنوا لـ Nvidia cards. لقيت أخطاء على المستوى المنخفض في PyTorch وTensorFlow أخدت وقت حقيقي للحل. حاجات معينة ما قدرتش أخليها تشتغل صح.

من الجانب الإيجابي، عملت شغل حقيقي بـ n8n على الماكينة دي. بنيت AI agent workflows، ضبطت RAG pipelines، وربطت multi-agent setups بـ MCPs. للبروتوتايبات السريعة، n8n كانت كسب. خلّتني أجرّب أفكار قبل ما أستثمر وقت في بناء agentic flows بـ LangGraph أو ADK.

بخصوص الصوت: ما كنتش عايز أصرف على مايك غالي قبل ما أعرف إن الموضوع ده هيكمل. فاستخدمت Adobe Podcast لتحسين تسجيلاتي بدل كده. نضّف الصوت كفاية إني ما احتجتش أستثمر في هاردوير من الأول. في الآخر روحت على Hollyland Lark wireless mic مع AI enhancement، لكن Adobe Podcast أعطاني وقت أتأكد إن الاستثمار يستاهل.

كمان استخدمت ElevenLabs لإنشاء نسخة صوتية مني. نفس منطق "اجرّب برخيص قبل ما تشتري" كان ماشي هنا برضو.

وبعدين جرّبت الحاجة اللي كنت عايزها فعلاً: تشغيل HunyuanVideo محلياً لتوليد الفيديو. GPU الـ Mac Mini M4 ما كانتش عندها ذاكرة كافية. ده كان نهاية التجربة دي.

النمط بقى واضح

شراءان من الهاردوير. حوالي $1,000 إجمالاً. الاتنين وصلوا لحدود GPU memory بسرعة كبيرة لأي شغل جدي. تشغيل الموديلات محلياً بنتايج محترمة محتاج استثمار ضخم في الهاردوير. بصيت في التكلفة الحقيقية لده وقررت: خلاص مش هلاحق الهاردوير المحلي.

أوائل 2025: التحوّل للـ Cloud

القرار ده غيّر كل حاجة. بدل ما أتصارع مع حدود الـ GPU، وجّهت workflows الـ n8n بتاعتي على cloud APIs فيها قوة حقيقية وراها.

بدأت أستخدم Google AI Studio وVertex AI Model Garden، بس مش بس لـ Gemini. كنت عايز أستكشف الموديلات التقيلة، أي حاجة فوق 16B parameters، من مزوّدين مختلفين: موديلات Anthropic، موديلات صينية، وغيرها. كنت عايز أربط n8n المحلي بتاعي بالتفكير المتقدم اللي بتجيبه تلك الـ cloud models. فجأة نفس الـ n8n اللي كان بيتعب محلياً بقى بيعمل شغل جاد.

NoteLLM بقى أكتر RAG tool جاهز بحبّه. استخدمته في حاجات مختلفة: تجهيز مصادر لفيديو YouTube الجاي، وتلخيص مادة دراسية. بيشتغل وخلاص.

كمان بدأت أكتب محتوى وأعمل YouTube thumbnails بـ Canva وقدراتهم الـ AI المدمجة. بين Canva وNoteLLM والـ cloud LLMs، كان عندي setup إنتاجي بيشتغل فعلاً. من غير أي تحديثات فيرموير، ولا أخطاء PyTorch، ولا حدود GPU memory.

أقل من $50 في الشهر. مجموع الكل.

2025: الدخول في عالم الـ Agentic

هنا الأمور بدأت تتحمّس.

Browser وComputer Use

في أوائل 2025، جرّبت agentic web scraping بـ Playwright. كان متعب. عشان تاخد نتايج موثوقة لازم تكتب سكريبتات هشّة، وتتعامل مع edge cases باستمرار، وتقضي وقت أكتر في تصحيح الأتمتة من الشغل الفعلي.

بعدين ظهرت أدوات زي Claude for Chrome وChrome agentic mode، وكانت قصة مختلفة خالص. قارنتهم مع Atlas وComet وManus. بعد الاختبار جنب بجنب، Chrome agentic mode طلع الأوفر للاستخدام. تقدر تنجز حاجات فعلاً بيه، خصوصاً لتصحيح الأخطاء واختبار الكود على web apps. الفرق بين scraping الـ Playwright في أوائل 2025 وين browser agents وصلوا دلوقتي ضخم جداً.

تعلّم الأنماط

قضيت وقت بتعلم ذاتي معمارية الـ agentic AI وأفضل طرق كتابة البرومبت. الموضوع اتجدّ لدرجة إني سجّلت فيديو YouTube بشرح فيه عدة أنماط: ReAct، وReflection، وPlanning، وTool Use، وMulti-Agent Collaboration، وSequential Workflow، وHuman-in-the-Loop.

تجميع الفيديو ده أجبرني أنظّم اللي اتعلمته في حاجة أقدر أشرحها فعلاً، وده هو المكان اللي بيحصل فيه الفهم الحقيقي.

البناء بـ AI-Powered IDE

على جانب الكود، استخدمت Replit عشان أبني النسخة الأولى من موقعي. دلوقتي بصوّنه بـ Claude Code وAntigravity، الـ agentic IDE بتاع Google اللي بتنافس Claude Code مباشرة. الأدوات دي غيّرت طريقة شحن الكود بتاعتي خالص.

اللي اتغيّر في الشغل

كل الاستكشاف الجانبي ده كان ليه تأثير مباشر على طريقة شغلي كـ Staff Engineer. بقيت أتواصل أحسن. كتابتي أنظف، قواعدي اللغوية أدق، وأقدر أنتج توثيق ومواصفات تقنية بوضوح وسرعة أكبر من قبل.

بين البرومبتات للمحتوى والكود وعمل المعمارية، أقدر أقول إن إنتاجيتي اترفعت على الأقل 10 مرات في مهام كانت بتاكل ساعات: صياغة مقترحات، مراجعة كود، كتابة مستندات تقنية، تجهيز عروض تقديمية. الـ AI مغيّرش بس اللي ببنيه على الجانب. غيّر طريقة شغلي كل يوم.

إلى أين ماشي ده

الرحلة دي كلها أقل من 20 شهر. لما بتطلع للخلف على اللي غطّيته، كتير. ولسه فيه أدوات وحوكمة كتير جاية. حتى اللاعبين الكبار بيتغيروا باستمرار.

أنا بتجنّب OpenAI دلوقتي. مش معجوب بالاتجاه اللي الشركة ماشيه فيه. حالياً عندي اشتراكات على GCP وClaude، للاستخدام الشخصي بس. أقل من $50 في الشهر مجموع الكل. التكرارات والموديلات الجديدة جايّة أسرع وأسرع. مخيف وبنفس الوقت مثير.

أنا مركّز دلوقتي على أعمق في منظومة Claude: skills، وcode، وcli، وcowork وغيرها.

لو بتبدأ الرحلة دي، نصيحتي الوحيدة: ابدأ باللاعبين الكبار في السوق. Google وAnthropic، اللي عندهم منظومة متكاملة. حتى لو متأخرين خطوة في benchmark معين، بيديوك الحزمة الكاملة: APIs، وأدوات، وتكاملات، وحجم، ودعم على المدى الطويل. الـ AI wrappers والأدوات الأصغر مش بتعمل كويس دلوقتي. اللي بيصمد هو اللي وراه شركات قادرة تفضل تشحن. روح لأماكن المنظومة، مش لأماكن الهايب، وخلّي الأخلاق دايماً في بالك.

الأمور مش بتبطأ. وأنا برضو.